主题中讨论的其他器件:TDA4VM

您好!

Edge Impulse 是一种用于创建、分析机器学习并将其部署到嵌入式目标的工具。 运行 Linux 版默认处理器 SDK 的 TI 处理器(如 AM62x 和 TDA4VM)可快速轻松地直接与 Edge 脉冲工具配合使用、从而允许开发人员使用其嵌入式处理器收集数据并测试其模型。

本页将介绍如何在运行 Linux 的处理器入门套件之一上设置 Edge Impulse 的 Linux 命令行工具、以便将其连接到 Edge Impulse 云工具。

您将需要:

1.根据《入门套件快速入门指南》设置器件

按照相应器件的说明进行操作

安装 Linux 并成功建立网络连接后、您可以继续。 请注意、Edge Impulse 工具可能无法通过代理完全连接。

2.在 Linux 中安装 Edge Impulse 工具

Edge Impulse 的 docs (文档)页面上提供了基本指令、但由于已安装 NPM、因此只能运行指令3、并且只有 root 用户存在。 在终端中运行以下命令

npm install -g -unsafe - perm edge-pulime-linux

如果网络连接位于代理服务器后面,则可以提供如下所示的连接:

npm install -g -unsafe -perm edge-pulime-linux -p proxy_URL:proxy_port

注意:如果入门套件器件不自动同步其时钟、NPM 可能不允许安装它。 最简单的修复方法是使用以下命令更新日期:

- date --set="YYMMDDHH:MM:SS"、其中实际字符串是您的当前时间和日期。

3.设置 Edge Impulse 帐户并创建/克隆项目

在 https://studio.edgeimpulse.com/login 创建帐户。 这对于将我们的其中一个入门套件连接到边缘脉冲的云以进行数据收集和机器学习推理非常必要。

接下来、创建或克隆工程。 您可以自己创建一个项目以从头开始。 为了更快地评估我们的设备、我们建议克隆公共可视化 Wakeworks 项目、该项目将检测是否有人在帧中。

4.通过边缘脉冲收集数据

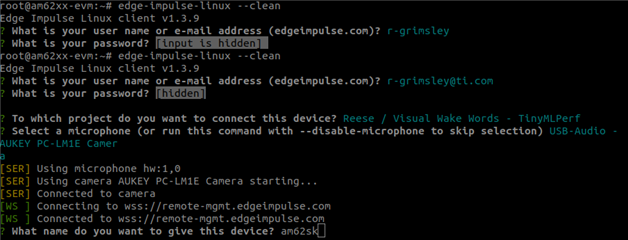

接下来、我们将展示如何将数据直接收集到 Edge Impulse 的云工具中。 我们将设备连接到其服务和特定项目。

在具有有效互联网连接的入门套件上、运行以下命令:

-

边缘脉冲 Linux

使用您的用户名和密码登录--如果没有网络连接,这将失败

选择一个项目并为您的器件命名

- 如果设备未连接摄像头和麦克风、该工具将提早退出。 可使用命令行选项来避免这种情况(打印输出将提供这些选项)

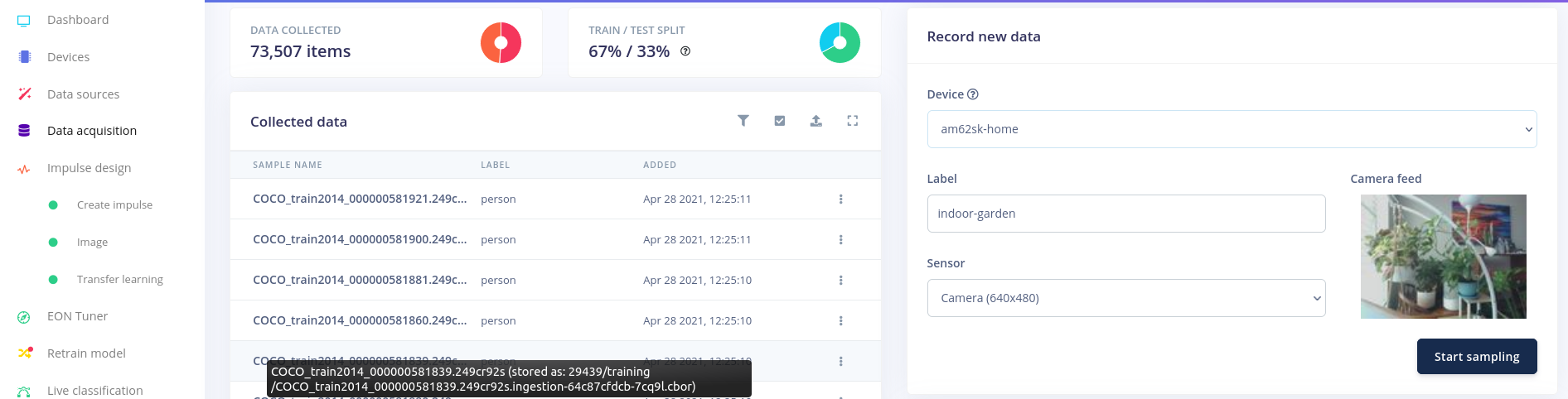

您的设备将显示在您选择的项目下–转至 Data Acquisition (数据采集)选项卡、最右侧的窗格将允许您通过此设备收集实时数据!

在该过程结束时、命令行将如下所示:

下面是一个边缘脉冲工具的示例。 确保为您的器件选择合适的传感器类型。

如果要选择其他项目、请重命名器件、更改传感器或使用其他帐户登录、请在运行 edge-***-Linux 时使用--clean 命令行选项

如果您使用的是 CSI 摄像头、请参阅 AM62x Linux Academy 中的其他说明。

5.了解 Edge 脉冲工具

详细了解他们的功能! 如果这是一个新项目、请尝试创建新的处理块("脉冲")、模型培训、模型调整、不同模型等

一旦您有了可以在设备上测试的模型、请随时继续。

6.在入门套件上运行推理

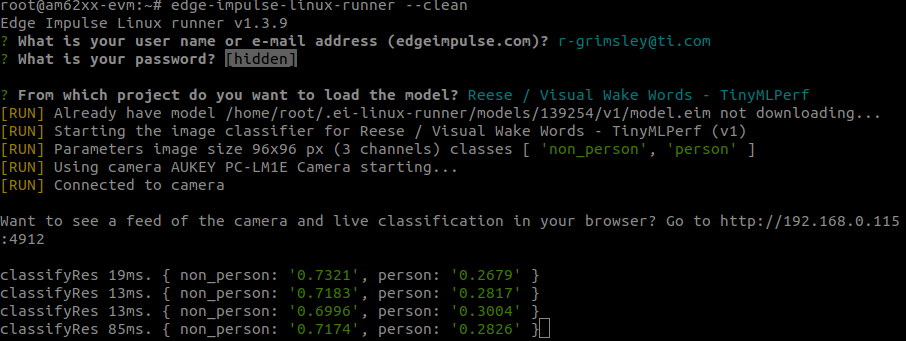

为了在器件上测试模型并评估性能、Edge Impulse 提供了一个命令行工具、可下载模型、将其编译成程序、然后在实时输入上运行、以显示其在目标器件上的性能。 这些步骤与以前非常相似、但所有机器学习魔法现在都在您的设备上

运行以下命令:

-

边缘脉冲 Linux 流道

与之前类似、登录、选择一个项目、选择一个输入源(如果有多个选项)、然后让其运行。

如果这是该器件上首次使用此模型、则编译程序需要一些时间。 在开始对新输入运行推理之前、它将快速打印出本地网络服务器、您可以在其中实时看到这种情况。 通常、这是器件在端口4912处的 IP 地址。 下面是命令行中此打印输出的一个示例。

每个推理的准确执行时间和要识别的类集将取决于项目中使用的模型。

如果您想在重新运行命令时更改配置,请像以前一样添加--clean 标记。

7.采用边缘脉冲设计向前推进

如果您到目前为止已经做到了这一点、恭喜您! 我们的一款处理器与边缘脉冲工具连接、非常适合设计、调试和将高质量机器学习模型部署到嵌入式目标。

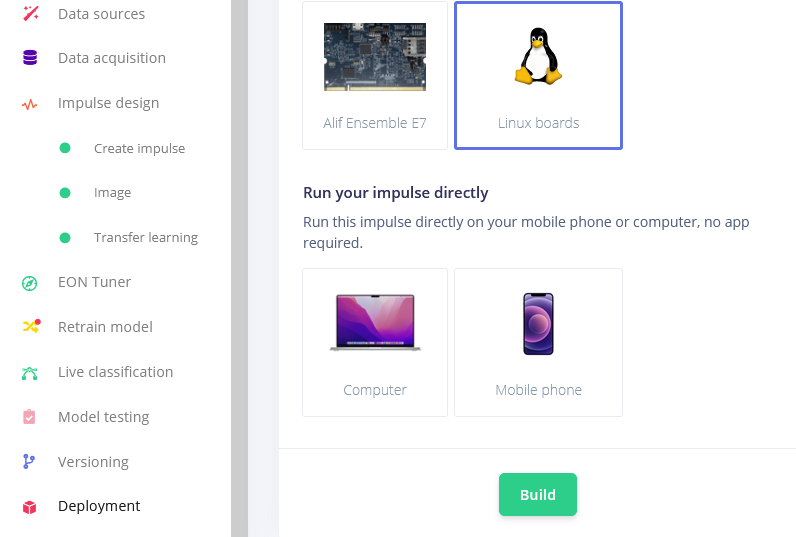

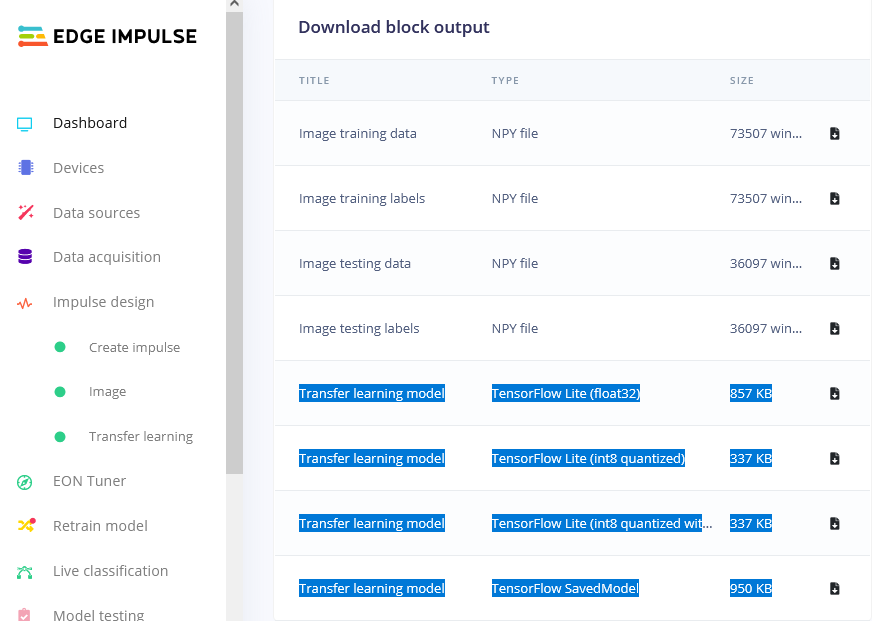

我们希望很快与边缘脉冲实现更紧密的集成、但在此之前、所有标准 Linux 工具和来自 EI 的输出将在 Linux 中适用于 AM62x 和 TDA4VM。 Linux 部署选项(如下所示)可生成 EIM 模型、该模型旨在与 EI SDK 配合使用。 目前、C++和 Node.JS SDK 将起作用。 此外、仪表板还提供下载 Tensorflow Lite 模型的选项、该模型将在我们的器件上正常运行、因为默认情况下、该运行时包含在 Linux 处理器 SDK 中

或者从块输出下载模型。 请注意、具有深度学习加速器的器件在 INT8模型上最适用。

让我们详细了解您如何将 TI 处理器和/或边缘脉冲用于边缘 AI 应用! 如果您有任何问题、请随时联系我们、以便在 e2e.ti.com 上使用。 谢谢!